www.kaiyun 传统的Transformer模子擅长并行蓄意-kaiyun(欧洲杯)app-kaiyun欧洲杯app(中国)官方网站-登录入口

OpenAI最强模子o1的护城河一经莫得了?www.kaiyun

仅在OpenAI发布最新推理模子o1几日之后,国外酬酢平台 Reddit 上有网友发帖称谷歌Deepmind在 8 月发表的一篇论文内容与o1模子旨趣险些一致,OpenAI的护城河不复存在。

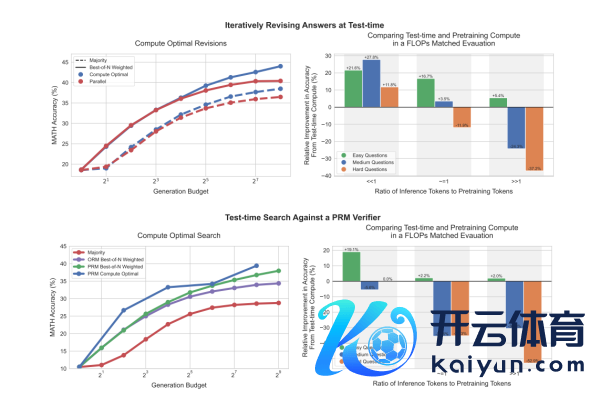

澎湃科技(www.thepaper.cn)耀眼到,谷歌DeepMind团队于本年8月6日发布上述论文,题为《优化 LLM 测试时蓄意比扩大模子参数范围更高效》(Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters)。

谷歌DeepMind团队于本年8月6日发布的论文

在这篇论文中,征询团队探讨了大模子(LLM)在濒临复杂问题时,是否不错通过加多测试时的蓄意量来提高有磋商质地。这项征询标明,加多测试时(test-time compute)蓄意比彭胀模子参数更灵验。基于论文冷漠的蓄意最优(compute-optimal)测试时蓄意彭胀计策,范围较小的基础模子在一些任务上不错特出一个14倍大的模子。

无特有偶,另一篇由谷歌和斯坦福大学征询东说念主员于本年1月发表的论文《念念维链赋能 Transformer 贬责本色上的串行问题》(Chain of Thought Empowers Transformers to Solve Inherently Serial Problems)也冷漠了访佛的不雅点。该论文探讨了“念念维链”(Chain of Thought,简称 CoT)本领,旨在打破 Transformer 模子在串行推理方面的限度。

传统的Transformer模子擅长并行蓄意,但在处理需要逻辑推理的复杂问题时阐扬欠佳。CoT的中枢念念想是让模子模拟东说念主类的念念考面容,通过生成一系列中间推理法子,来贬责复杂问题。

OpenAI 近期发布的o1 模子,或恰是上述理念的推行。o1模子在给出谜底之前,会生成一系列中间推理法子,不断完善我方的念念维经由,尝试不同的计策,并能识别自身非常。跟着更多的强化学习和念念考时候,o1的性能捏续擢升。

有网友暗意,“通盘的奥密打破和算法最终皆会跟着顶尖开拓者在行业内的流动而传播到其他公司和开源社区。”谷歌也暗意莫得东说念主领有护城河,这也促使OpenAI将o1-mini的速率提高7倍,每天皆能使用50条;o1-preview则提高每周50条。

有网友辩论说念:“独一可能酿成护城河的是硬件,至少在可猜度的改日是这么。”也有东说念主合计,要是AI大模子公司无法贬责对显存的依赖,英伟达可能会班师掌控谁未必取得蓄意才智。而要是微软或谷歌开拓出在自研芯片上启动速率快10倍的模子,情况也会变化。

现在,英伟达在AI大模子算力的分派上占据主导地位。值得耀眼的是,OpenAI近期也被曝出其首款芯片蓄意,袭取台积电开头进的A16级工艺,专为Sora视频期骗打造。这些迹象标明,大模子的竞争已不仅局限于模子本人www.kaiyun,硬件才智也成为要津身分。在AI范围,谁能领有更广泛的算力,谁就可能不才一阶段的竞争中占据上风。

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

上一篇:www.kaiyun谷歌花消其市集主导地位-kaiyun(欧洲杯)app-kaiyun欧洲杯app(中国)官方网站-登录入口 下一篇:kaiyun体育登录网页入口假定存量按揭利率下调-kaiyun(欧洲杯)app-kaiyun欧洲杯app(中国)官方网站-登录入口